- Se trata de programas creados con Inteligencia Artificial que interactúan con los usuarios a través de texto o voz, y ofrecen apoyo emocional inmediato, intervención en crisis, entrega de información u orientación para conectar con profesionales.

De acuerdo con la novena versión del Termómetro de Salud Mental de la ACH y la UC, un 13,4% de los encuestados muestra sospechas o presencia de problemas de salud mental. Aunque esta cifra representa una disminución en comparación con mediciones anteriores, sigue reflejando un problema significativo en el país.

La tecnología está desempeñando un papel fundamental en la contención y orientación de diversos problemas psicológicos. Gracias al uso de la Inteligencia Artificial, se han desarrollado chatbots de salud mental, programas que interactúan con los usuarios a través de texto o voz, y que pueden ofrecer apoyo emocional inmediato, intervención en crisis, así como información y orientación para conectar con profesionales de la salud.

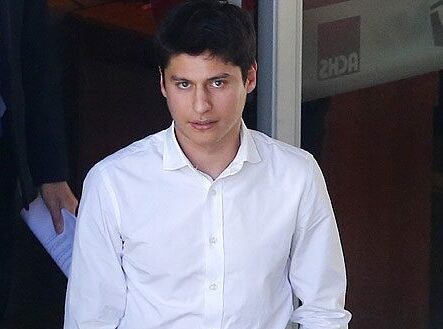

Al respecto, el psicólogo Álvaro Jiménez, académico e investigador de la Facultad de Psicología y Humanidades de la Universidad San Sebastián (USS) y del Núcleo Milenio Imhay, explica que estos sistemas “permiten monitorear el estado de ánimo y acompañar intervenciones terapéuticas. Además, una de sus ventajas es el anonimato, lo que ayuda a superar barreras relacionadas con la estigmatización y las dificultades logísticas para acceder a ayuda”.

En términos generales, los chatbots de salud mental pueden ser un aporte en situaciones de crisis, ya que están programados para reconocer señales de riesgo o crisis como pensamientos suicidas. Al respecto, Jiménez indica que “al estar disponibles 24/7 son capaces de detectar señales de alerta de manera temprana, lo que facilita la intervención oportuna por parte de profesionales de la salud. Por otro lado, pueden promover la búsqueda de ayuda o conectar a los usuarios con líneas de ayuda”.

Otra de las utilidades de este tipo de chatbots, señala el académico, es que “proporcionan información sobre temas relacionados con salud mental en contextos donde los recursos o el acceso es limitado, como, por ejemplo, en áreas rurales o países de bajos ingresos”. Sin embargo, recalca que no son de provecho cuando se padecen problemas de salud mental severos.

Eventuales riesgos en torno a su uso

Aunque los chatbots de salud mental pueden generar alertas en tiempo real y conectar a los usuarios con profesionales de la salud, todavía se encuentran en una fase temprana de desarrollo y enfrentan importantes desafíos. Como explica Jiménez, “existen desafíos en términos de seguridad y privacidad de las interacciones. Aunque se presentan como herramientas confidenciales, los chatbots pueden utilizar la información privada de los usuarios para fines comerciales, como entrenar otros algoritmos de IA. Actualmente existe una falta de regulación en el uso de estas tecnologías en salud mental, lo que deja brechas en la protección de datos personales de los usuarios”.

Por otro lado, existen riesgos asociados a los sesgos de diseño o programación de la Inteligencia Artificial. “Estos sesgos algorítmicos suponen desafíos éticos, ya que los chatbots pueden reproducir desigualdades al estar mal diseñados para grupos vulnerables o tradicionalmente marginados. De hecho, los chatbots no tienen la capacidad de comprender el mundo subjetivo de las personas en su contexto, es decir, dentro de múltiples factores socioculturales y contextuales que afectan la salud mental”, indica el investigador.

En cuanto a las particularidades del trabajo en salud mental, Jiménez subraya que uno de los principales desafíos radica en la relación que se establece con la tecnología y en sus limitaciones para comprender situaciones emocionales complejas.

“El marketing de estas aplicaciones se basa en humanizar a la máquina para explotar la confianza del usuario, lo que puede llevar a malentendidos sobre sus capacidades. Por ejemplo, algunos chatbots se presentan como agentes terapéuticos, lo que fomenta malentendidos o expectativas poco realistas sobre su capacidad para proporcionar apoyo”. Por lo tanto, es importante que los usuarios comprendan que esta tecnología no sustituye el apoyo que ofrecen terapeutas o profesionales de salud. Al respecto, el investigador USS indica que “muchos chatbot han mostrado interacciones inadecuadas ante determinados síntomas o estados emocionales. Los seres humanos utilizamos metáforas o expresiones lingüísticamente complejas para manifestar nuestros estados emocionales, muchas veces con ambivalencia, sutilezas que los chatbots pueden malinterpretar. En ese sentido, los chatbot no han superado a los humanos en su capacidad de reconocer síntomas ni de diagnóstico”, enfatiza Jiménez.

Reconociendo que los chatbots pueden ser herramientas muy valiosas en salud mental, Jiménez indica que “un riesgo importante está asociado a los incentivos del proceso de desarrollo de algoritmos de inteligencia artificial en salud. Me parece que existe un riesgo real de aumento de la medicalización o patologización de estamos emocionales que son respuestas normales y adaptativas frente a situaciones estresantes de la vida. Los chatbots podrían contribuir a patologizar la tristeza, y de ese modo podrían contribuir al sobrediagnóstico de problemas de salud mental. Por ello es muy importante que evaluemos rigurosamente estas tecnologías, es crucial involucrar a los usuarios finales en su desarrollo y que la comercialización sea transparente sobre sus limitaciones para evitar malentendidos terapéuticos o respuestas inadecuadas en situaciones de crisis”.